在当今人工智能快速发展的时代,大型语言模型已成为科技领域的热点话题。DeepSeek R1作为一款先进的大型语言模型,以其强大的自然语言处理能力和广泛的应用前景,吸引了众多研究者和开发者的关注。然而,对于许多初学者和爱好者来说,如何在本地电脑上安装和运行这样一款大型语言模型仍然是一个不小的挑战。本文将详细介绍DeepSeek R1大型语言模型在本地电脑上的安装与运行方法,旨在帮助读者轻松掌握这一技能,从而更好地利用DeepSeek R1进行自然语言处理相关的研究和开发。

一、环境准备

电脑配置越高可以运行版本更高的DeepSeek R1模型。

DeepSeek R1模型版本越高,参数越多,模型越大,效果越好。

我的电脑配置如下

CPU:R7 5800

显卡:RTX3060 12G独显

内存:32G

网络:需要稳定的互联网连接以下载模型文件。

二、安装Ollama

2.1 访问Ollama官方网站

Ollama官方网站:https://ollama.com/

2.2 下载适用于Windows的安装包

单击右上角“Download”按钮

官网如果下载的慢,可以选择网盘下载,方法如下。

关注【小康师兄】微信公众号,回复【Ollama】即可获取下载链接。

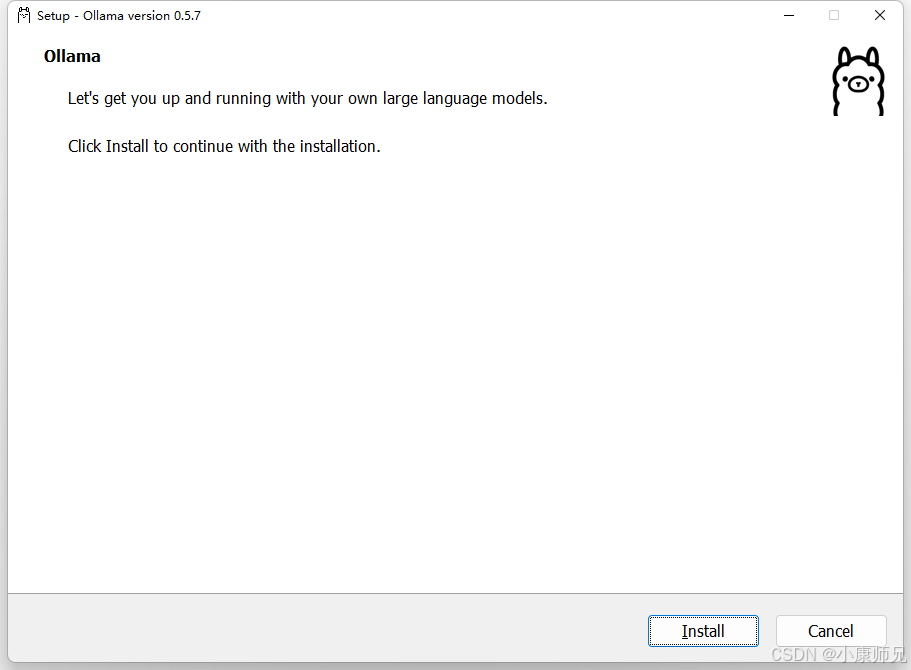

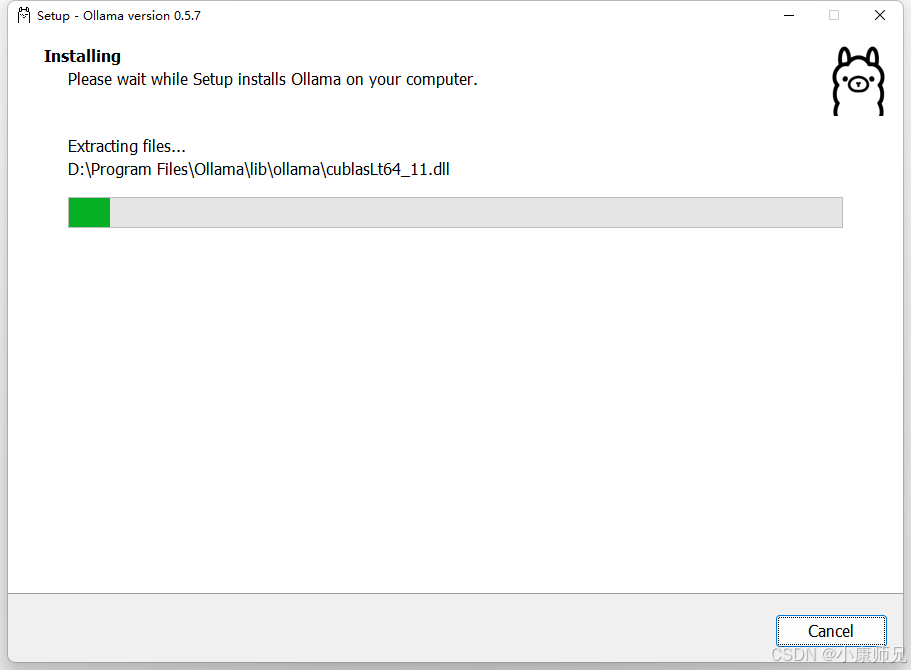

2.3 安装Ollama安装包

双击安装包,按照安装向导的提示完成安装。

安装完成后,可以在开始菜单中找到Ollama。

不过这种方式只能安装在C盘(C:\\Users\\weijian\\AppData\\Local\\Programs\\Ollama)

这个安装包还不够完善,没有选择安装路径的选项。

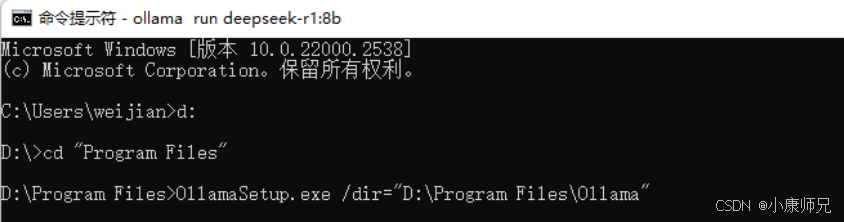

2.4 指定Ollama安装目录

通过OllamaSetup.exe /dir=\"D:\\Program Files\\Ollama”命令可以指定Ollama安装目录

C:\\Users\\weijian>d:D:\\>cd“ProgramFiles\"D:\\ProgramFiles>OllamaSetup.exe/dir=\"D:\\ProgramFiles\\Ollama”

2.5 指定Ollama的大模型的存储目录

打开 “开始” 菜单,搜索 “环境变量”,点击 “编辑系统环境变量”。

在 “系统属性” 窗口中,点击 “环境变量” 按钮。

在 “用户变量” 下,点击 “新建”,输入变量名 “ollama_models”,变量值为你想要存储模型的目录路径,如 “D:\\ollama_models”,点击 “确定” 保存更改。

若 Ollama 已经在运行,需先关闭托盘应用程序,然后从开始菜单重新启动,或在保存环境变量后启动新的终端。

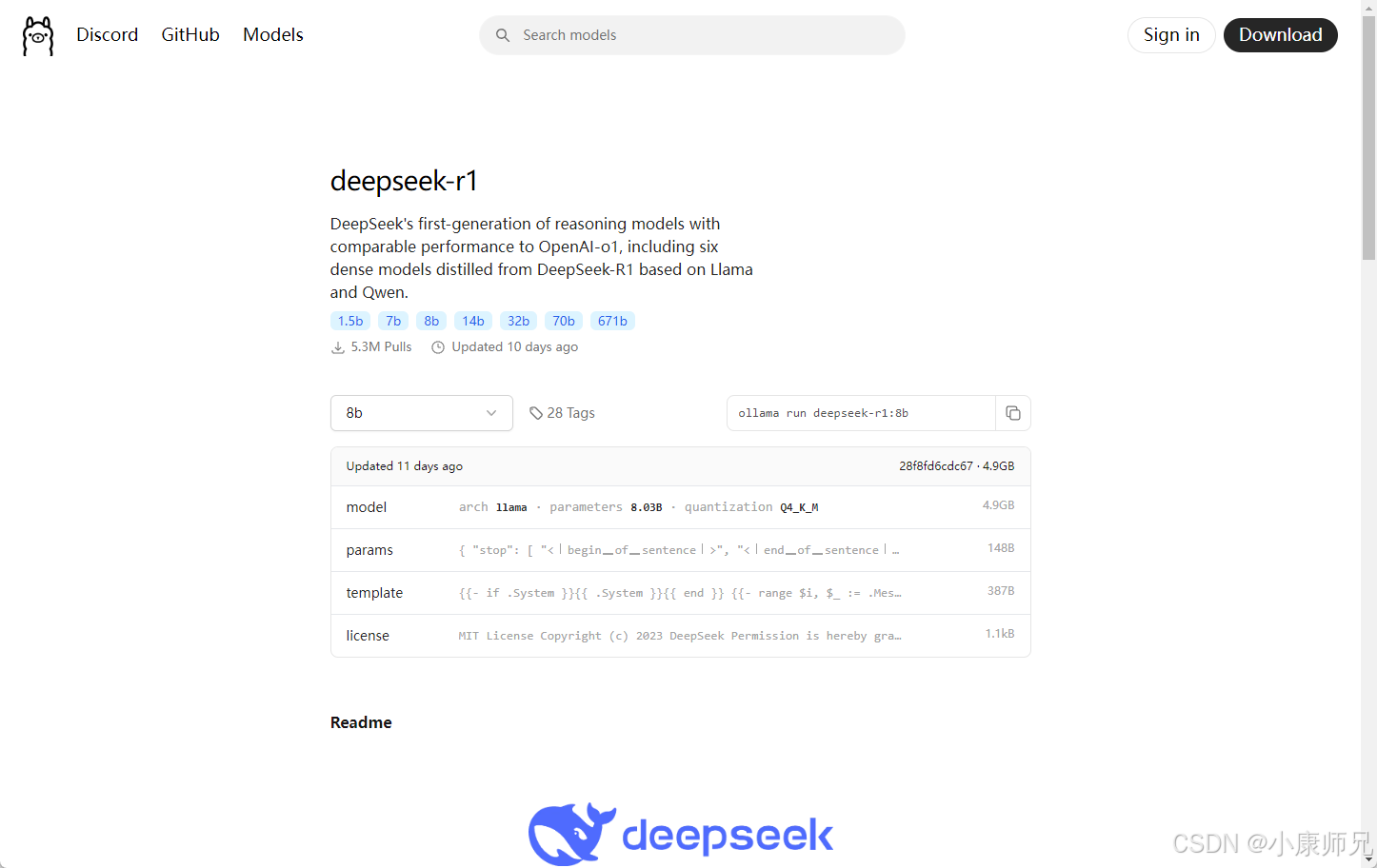

三、选择DeepSeek R1模型

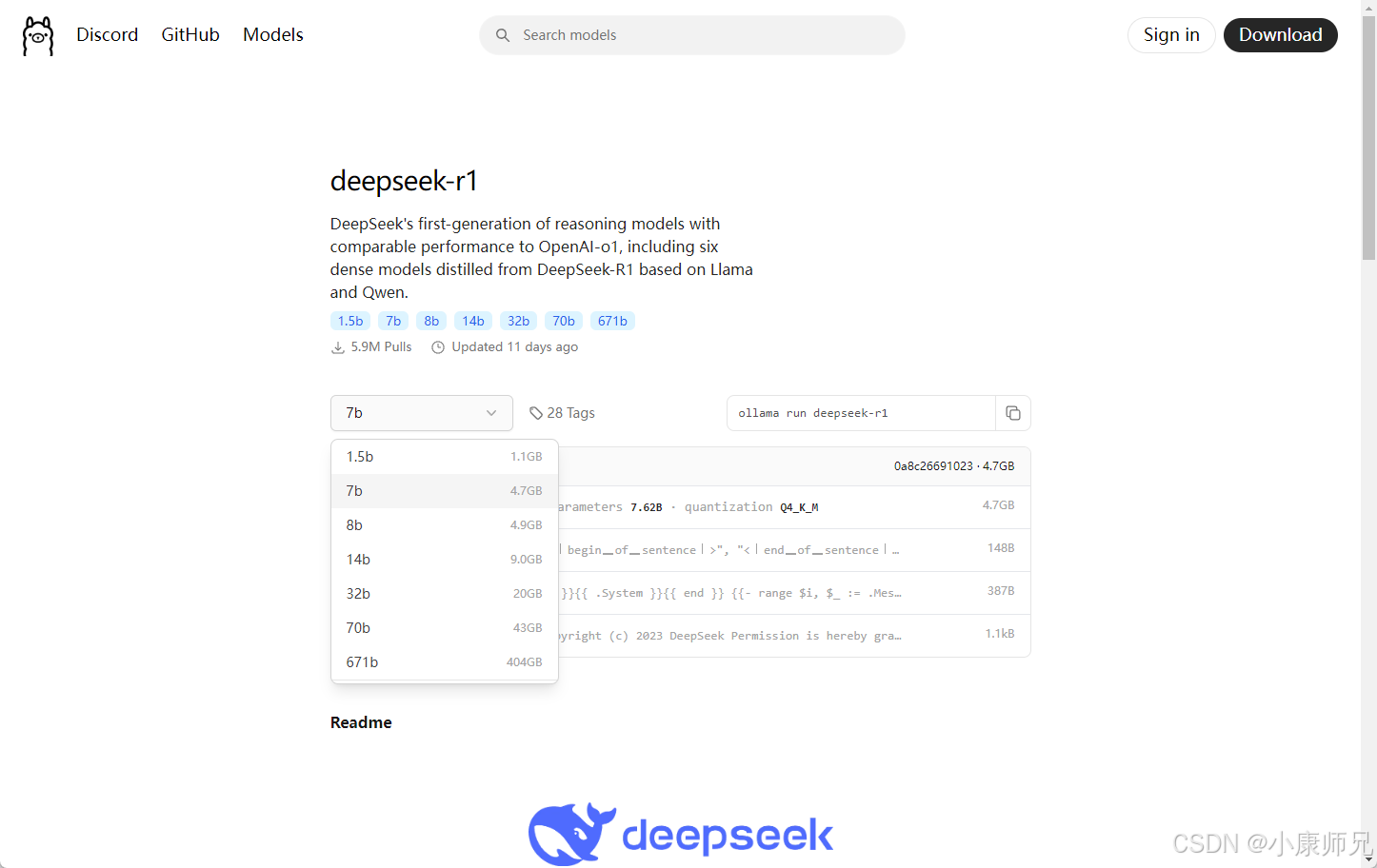

DeepSeek-R1有多种版本,适配不同的硬件配置(如下图)。

主要取决于GPU的显存大小。

注意:是GPU的显存,不是电脑的内存。

简单列举了几个高性能显卡的参数。

| 显卡 型号 | 性能评级 | 显存容量 | 显存类型 |

|---|---|---|---|

| RTX 4090 | S | 24GB | GDDR6X |

| RX 7900 XTX | S | 24GB | GDDR6 |

| RTX 4080 SUPER | A+ | 16GB | GDDR6X |

| RX 7900 XT | A+ | 20GB | GDDR6 |

| RTX 4070 Ti SUPER | A | 12GB | GDDR6X |

| RX 7900 GRE | A | 16GB | GDDR6 |

| RTX 3090 Ti | A | 24GB | GDDR6X |

| RX 6950 XT | A | 16GB | GDDR6 |

| RTX 4070 Ti | A | 12GB | GDDR6X |

| RX 7800 XT | A- | 16GB | GDDR6 |

四、下载并运行DeepSeek R1模型

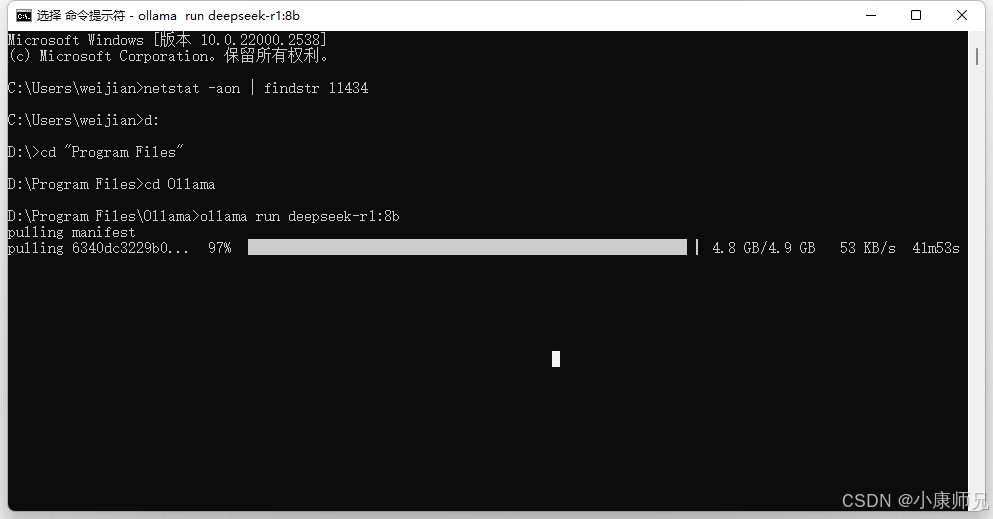

打开 Windows PowerShell(管理员)或终端管理员。

输入以下命令下载模型(以 8B 版本为例):

ollamarundeepseek-r1:8b

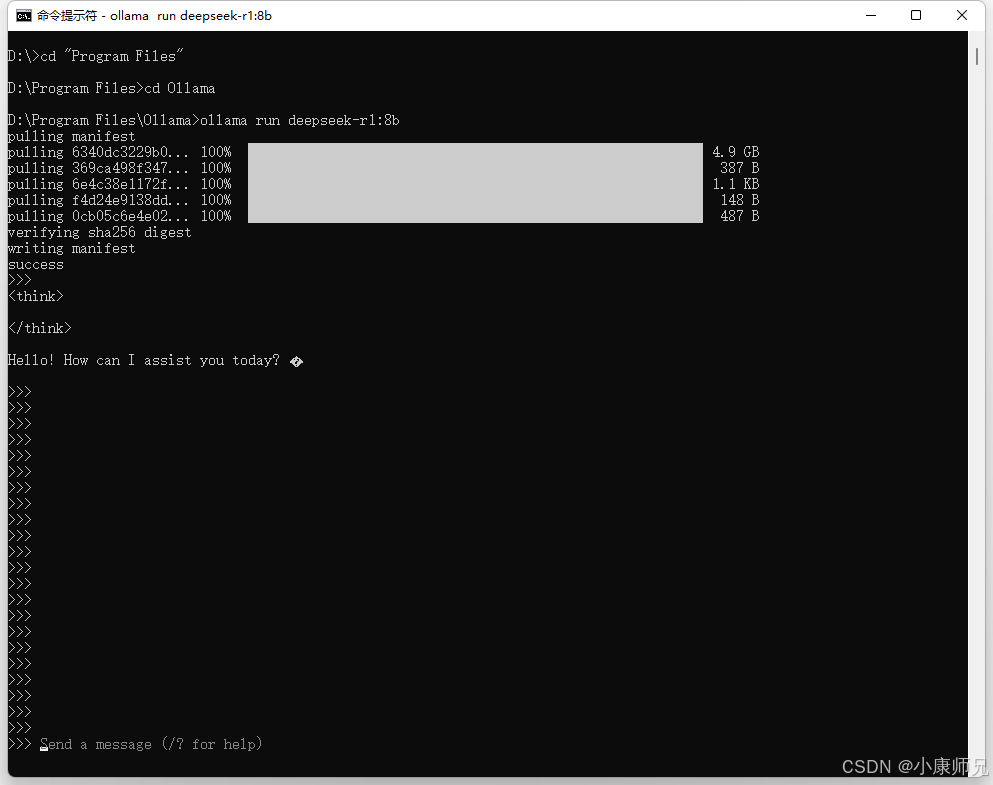

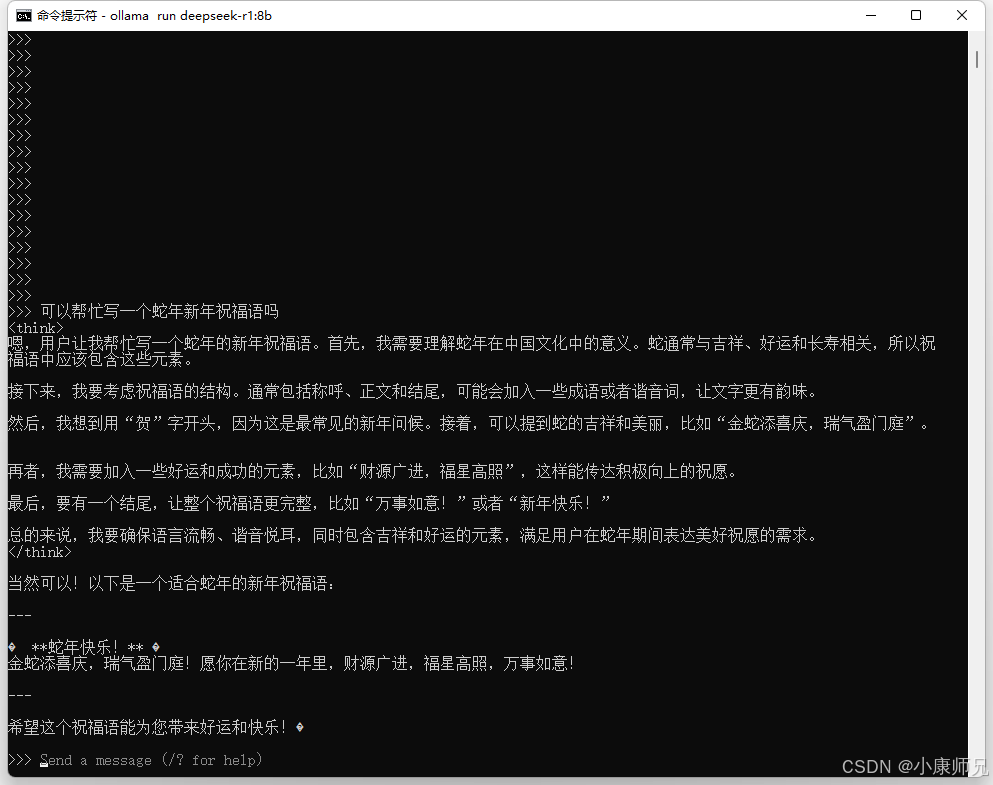

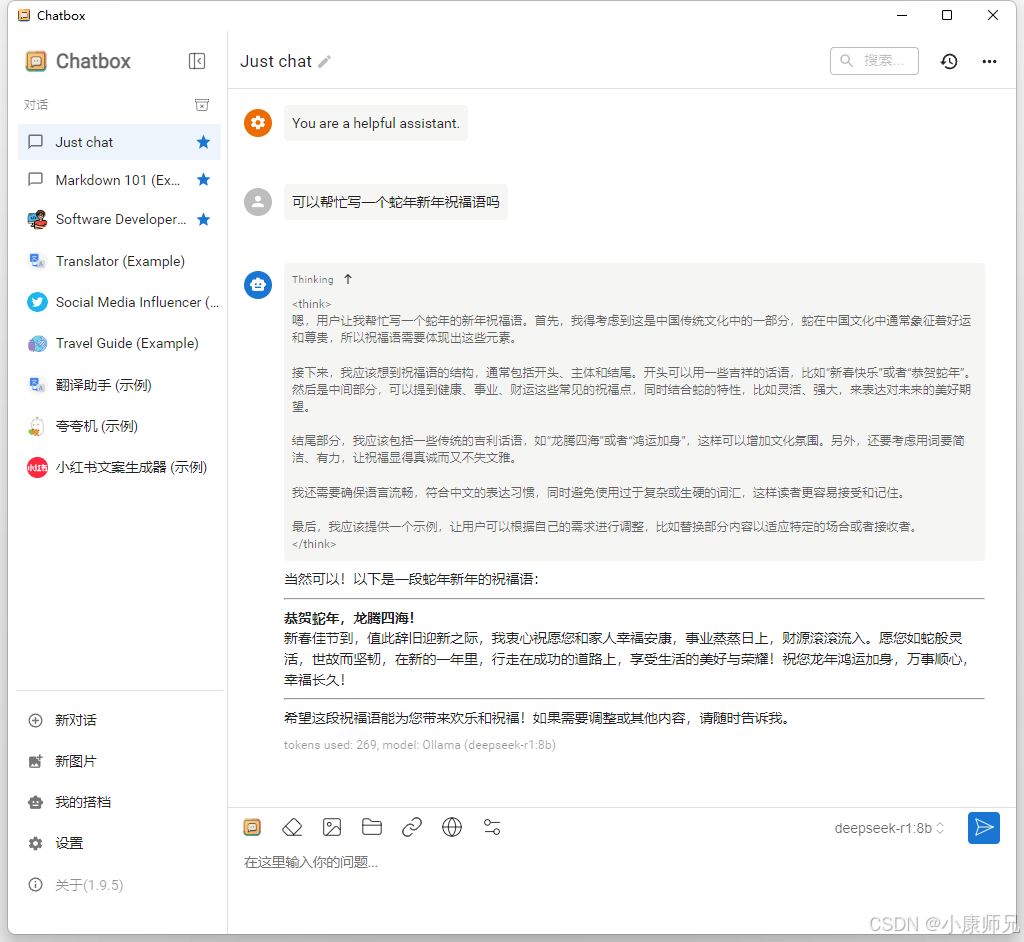

下载完成后,模型会自动运行,您可以在终端与模型进行交互,输入问题或任务,模型将提供相应的响应。

如果需要重新进入模型交互界面,可以在 PowerShell 中输入以下命令:

ollamarundeepseek-r1:8b

五、常见问题解答

模型加载时间过长:可能是由于硬件性能或网络速度限制。请确保系统满足模型的硬件要求,并检查网络连接。

内存不足错误:考虑使用较小的模型版本或升级硬件配置。

模型响应不准确:确保按照推荐的配置使用模型,例如将温度设置在 0.5-0.7 之间,并避免添加系统提示符。

启动Ollama报错:Error: listen tcp 127.0.0.1:11434: bind: Only one usage of each socket address (protocol/network address/port) is normally permitted.

netstat -aon | findstr 11434:查找占用端口的进程。

tasklist | findstr \"6892\":查看该进程的详细信息。

taskkill /PID 6872 /F:杀死该进程。

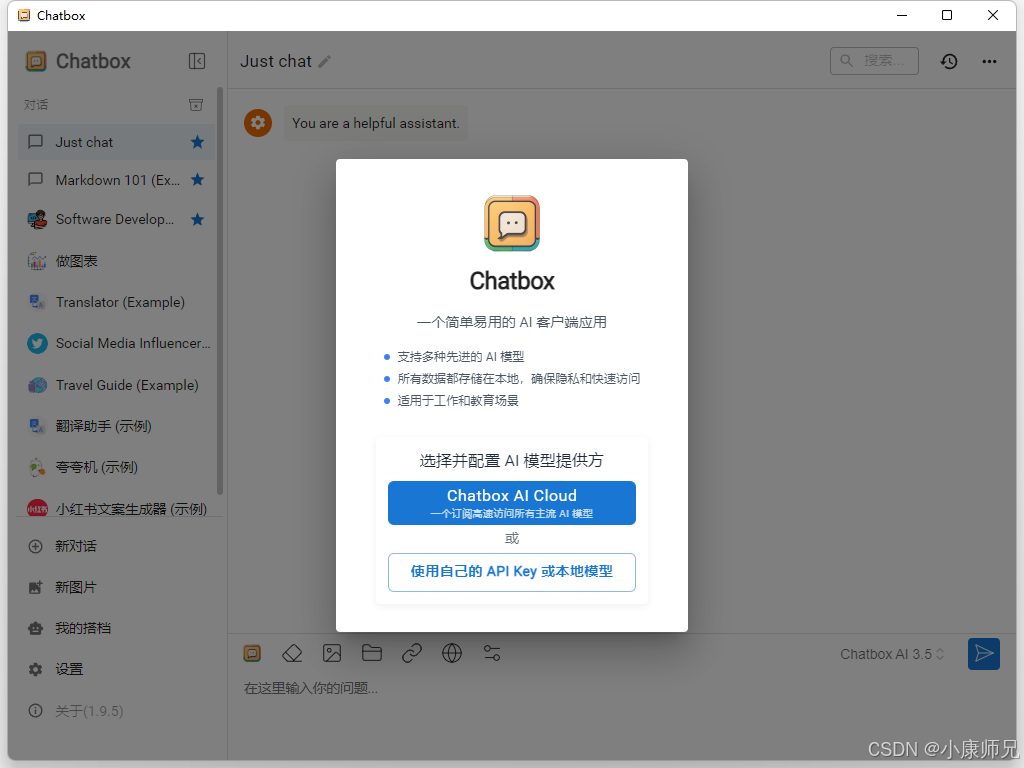

六、使用Chatbox进行交互

6.1 下载Chatbox安装包

访问Chatbox官方网站(https://chatboxai.app/zh),下载适用于 Windows 的版本。本站下载地址:https://www.zhanid.com/pc/928.html

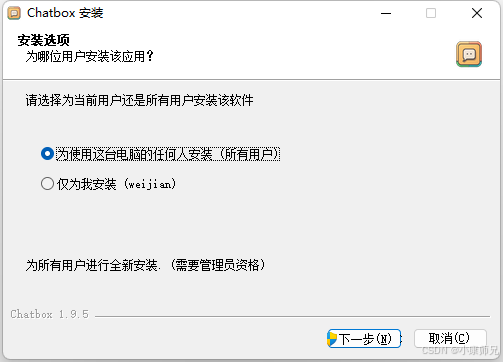

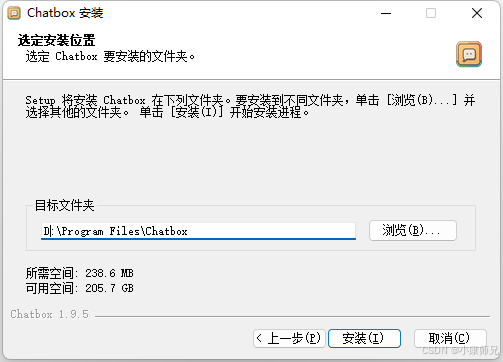

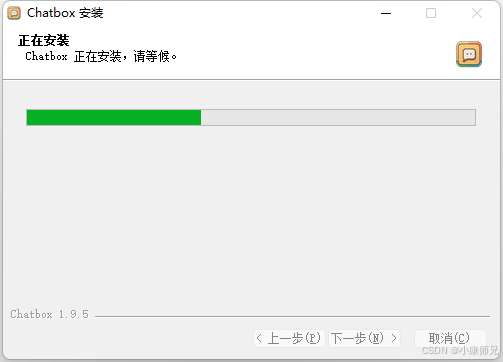

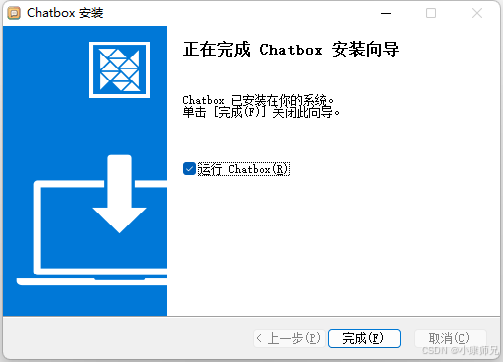

6.2 安装并启动 Chatbox

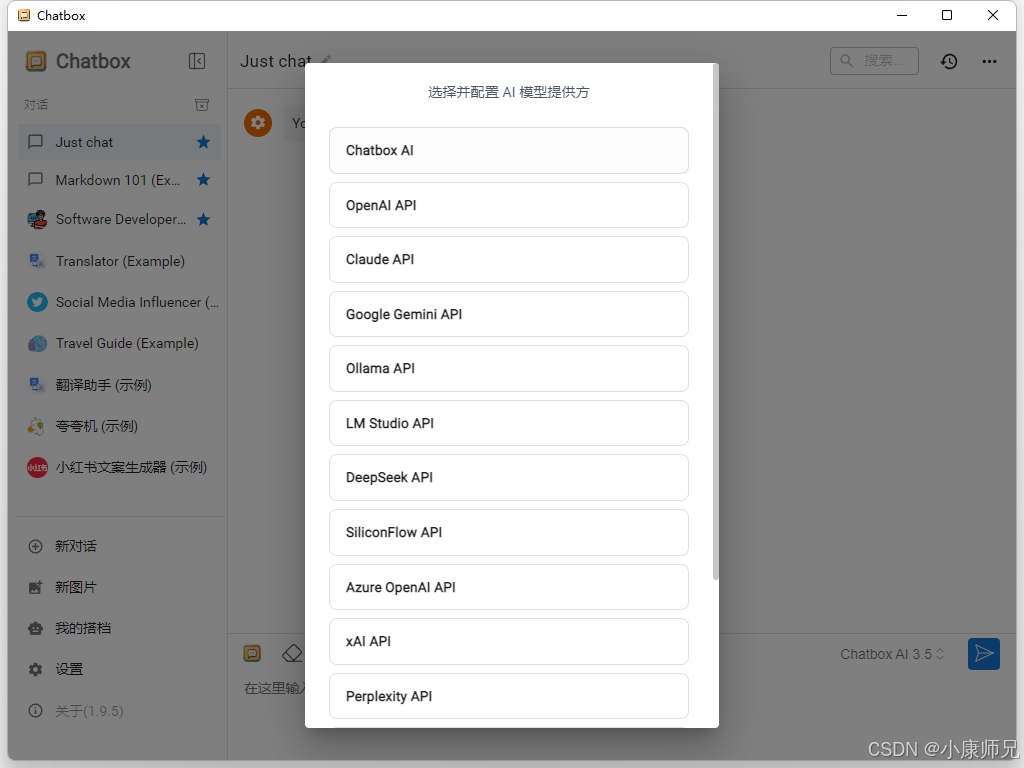

6.3 配置Chatbox

API类型:选择 “OLLAMA API”。

接口地址:填写 http://localhost:11434。

模型名称:填写 deepseek-r1:8b,确保与之前下载的模型版本一致。

最后就可以在本地使用DeepSeek R1模型啦

七、总结

主要使用两个开源软件,才将DeepSeek R1大模型运行起来。

7.1 Ollama介绍

Ollama 是一个开源的框架,主要用于在本地机器上便捷地部署和运行大型语言模型(LLM)。以下是关于 Ollama 的详细介绍:

简化部署:Ollama的设计目标是简化在Docker容器中部署大型语言模型的过程,使得非专业用户也能方便地管理和运行这些复杂的模型。

轻量级与可扩展:作为一个轻量级框架,Ollama保持了较小的资源占用,同时具备良好的可扩展性,允许用户根据需要调整配置以适应不同规模的项目和硬件条件。

API 支持:Ollama提供了一个简洁的API,使得开发者能够轻松创建、运行和管理大型语言模型实例,降低了与模型交互的技术门槛。

预构建模型库:Ollama包含一系列预先训练好的大型语言模型,用户可以直接选用这些模型应用于自己的应用程序,无需从头训练或自行寻找模型源。

模型导入与定制:Ollama支持从特定平台(如GGUF)或其他深度学习框架(如PyTorch或Safetensors)导入已有的大型语言模型,并允许用户为模型添加或修改提示(prompt engineering)

7.2 Chatbox介绍

Chatbox 是一款开源的聊天界面工具,专为与本地运行的大型语言模型(如 Ollama、Llama、Vicuna 等)进行交互而设计。

它提供了一个简单易用的图形用户界面(GUI),使用户能够更方便地与本地部署的语言模型进行对话,而无需编写复杂的代码或使用命令行工具。

本文通过详细的步骤和说明,成功指导了读者如何在本地电脑上安装和运行DeepSeek R1大型语言模型。从电脑配置要求到Ollama框架的安装,再到模型的选择、下载、运行以及交互方式,本文都进行了全面的介绍。同时,针对可能出现的常见问题,本文也提供了相应的解决方案。通过本文的学习,读者不仅能够掌握DeepSeek R1模型的本地部署方法,还能够更好地理解和应用这款强大的语言模型,为自然语言处理领域的研究和开发贡献自己的力量。